практическая работ рек сети. Практическая работа №5. Рекуррентные нейронные сети. Практическая работа 5. Рекуррентные нейронные сети у нас есть два предложения

Скачать 0.64 Mb. Скачать 0.64 Mb.

|

|

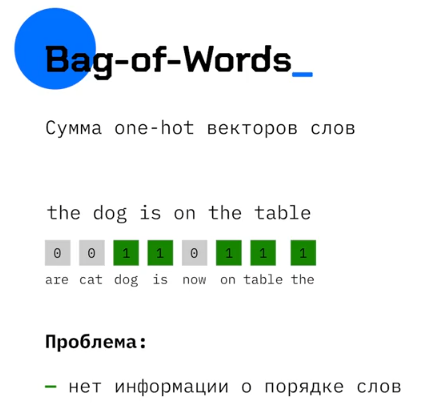

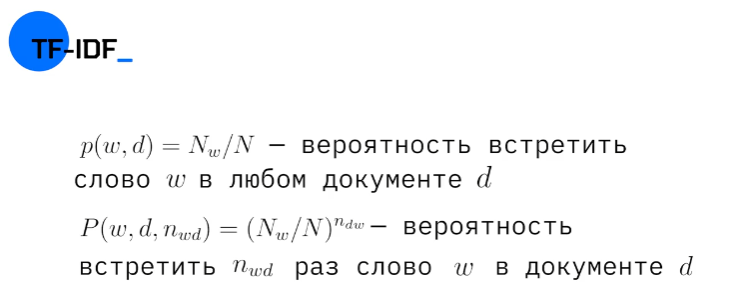

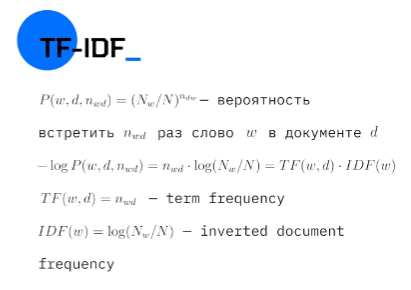

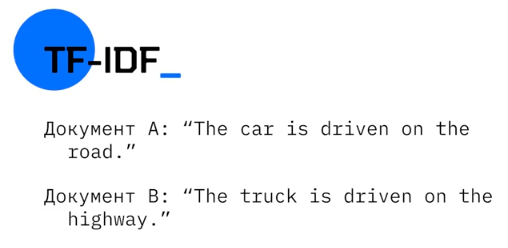

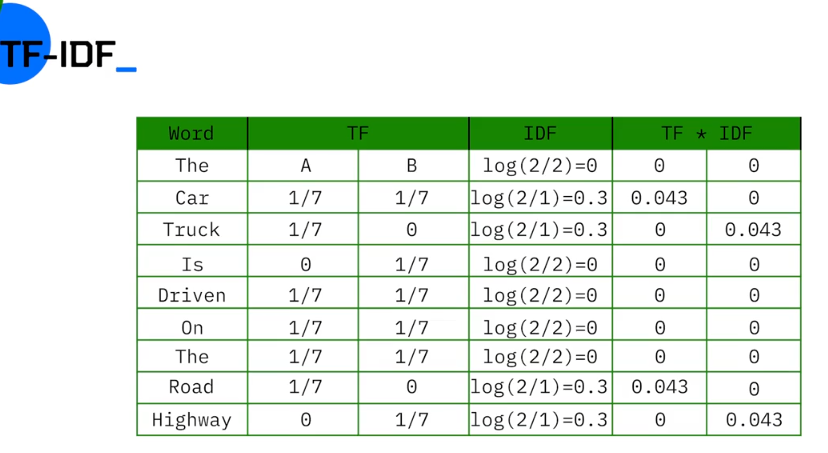

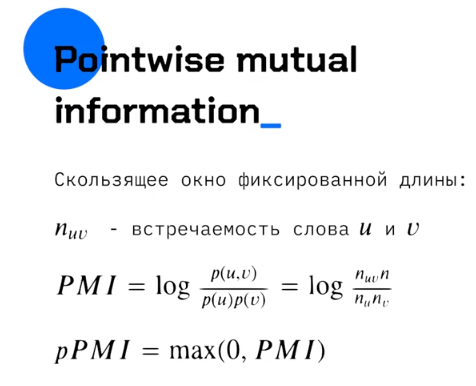

Практическая работа №5. Рекуррентные нейронные сети У нас есть два предложения. Первое предложение: "My dog is on my table ." Второе предложение: "The dog is on the table ." Имеем следующие стоп-слова: ['can', 'is', 'if', "the", 'have', 'that', 'been' ]. Применим модель bag-of-words к каждому предложению, не учитывая стоп-слова. Тем самым получим векторные представления предложений. Вектора не содержат информацию о стоп-словах. Чему равно евклидово расстояние между векторными представлениями предложений? У нас есть два предложения. Первое предложение: "My dog is on my table ." Второе предложение: "The dog is on the table ." Будем вычислить значение метрики TF-IDF. В данном случае мы не будем учитывать регистр символов, то есть слово "The" то же самое, что и слово "the". Посчитайте значение TF-IDF слова "my" для первого предложения. Используйте десятичный логарифм и округлите математически до первого знака после запятой. Пусть в нашем словаре 1000 слов. Мы хотим, чтобы каждое слово описывалось вектором размером 30. Сколько в этом случае у нас будет обучаемых весов в моделе Word2Vec? Мы обучили модель Word2Vec. Размер векторного представления каждого слова равен 30. У нас есть предложение: "My dog is on my table". Мы бежим по тексту окном размера 2, то есть, например, когда слово "is" центральное, то наше окно будет выглядеть так: "My dog is on my table". Мы предсказываем вероятность контекстных слов при окне равным 2, когда центральное слово сначала "is", а потом слово "on". Сколько параметров нашей модели в сумме было использовано для предсказания вероятностей? Не учитывайте повторения использования параметров. Теория           |