Лекция Законы распределения случайных величин. Лекция Законы распределения. Лекция4. Законы распределения случайных величин. Вопросы Равномерное распределения св

Скачать 212.5 Kb. Скачать 212.5 Kb.

|

|

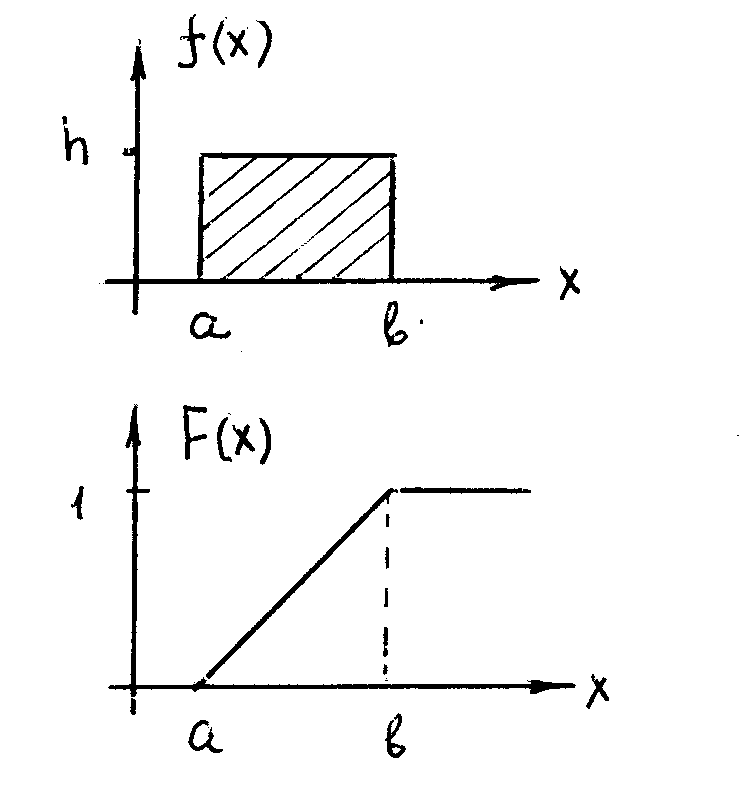

Лекция№4. Законы распределения случайных величин. Вопросы: Равномерное распределения СВ. 2. Биноминальный закон распределения. 3. Распределение Пуассона 4. Показательное распределение. 5. Нормальное распределение (распределение Гаусса). Существует несколько основных типов распределения СВ, которые часто используются на практике. Рассмотрим их.1. Равномерное распределения СВ. Определение1. Равномерным называется распределение СВ , значения которых лежат на некотором отрезке [a,b] и имеют постоянную плотность вероятности h . И  з условия нормировки: h(b – a) = 1 з условия нормировки: h(b – a) = 1 f(x) =  ; ;F(x) =  (1) (1)МО M(Х) = т.е. в центре распределения. Дисперсия : D(X) = |

| Xi | 0 | 1 |

| pi | q | p |

M(Xi) = 0 . q + 1 . p = p, но X = X1 + . . .+ Xn и

M(X) =

Найдем D(X) и

Распределения и математические ожидания для X2i и Xi совпадают.

M(X2i) = 02q + 12p = p. Поэтому D(Xi ) = M(X2i) - M2(Xi ) = p – p2 = p(1 – p) = pq и D(X) =

Отсюда

3. Распределение Пуассона

Имеем серию n независимых испытаний ( n = 1, 2, 3, . . . ). Считаем, что вероятность появления события А зависит от номера серии P(A) = pn > 0 и убывает с ростом n так, что для каждой серии среднее число появления события А постоянно, т.е. npn = ., или pn = /n . Такая ситуация часто бывает на практике, когда рост n означает увеличение интервала (1, n), а вероятность pn , по условию задачи, обратно пропорциональна его величине.

Если n достаточно велико, то получаем приближенную формулу Пуассона

Pn(m) =

Определение 3. СВ Х распределена по закону Пуассона , если ее задает таблица

-

X

0

1

2

3

. . .

P

e-

e-  e-

e-  e-

e-

. . .

Проверим нормировку P и найдем математическое ожидание

M(X) =

Аналогично получаем M(X2) = 2 + и D(X) = M(X2) - M2(X) =

4. Показательное распределение.

Пусть изменение плотности вероятности f(x) в окрестности точки х пропорционально значению f(x) в этой точке и величине изменения х: f(x) =- f(x)x или d f(x) = - f(x) dx. Решение этого диф. уравнения df(x) / f(x) = - dx имеет вид ln f(x) = - x + C или f(x) = C

В

результате получаем показательное распределение

результате получаем показательное распределениеf(x) =

M(X) = 1/ , D(X) = 1/2 ,

Если эксперимент дает M(X) =

Если при показательном распределении неизвестно , то его определяют по математическому ожиданию: = 1/M(X) .

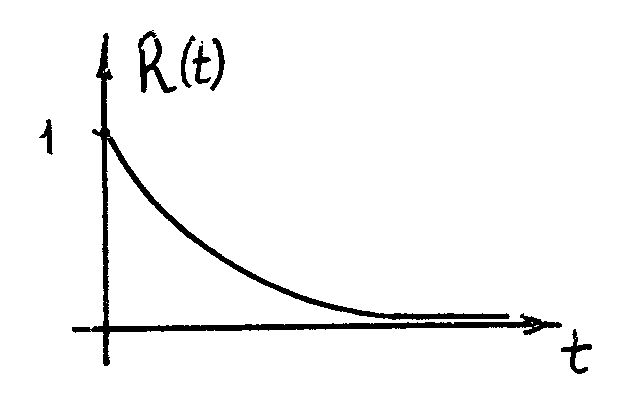

Показательный закон надежности. Пусть Т – время безотказной работы какого-либо устройства. Значения переменной величины 0 < T < t задают непрерывное множество СВ, которые определяют факт отключения устройства в момент времени Т. Тогда, функция распределения вероятностей этих СВ F(t) = P(T < t) определяет вероятность отключения устройства к моменту времени t . Вероятность противоположного события, т.е. безотказной работы за время t, равна R(t) = 1 – F(t) и наз. функцией надежности.

В случае показательного распределения F(t) = 1 – e-t получаем показательный закон надежности R(t) = e-t , где наз. интенсивность отказа. Это случай, когда безотказная работа устройства зависит только от величины временного интервала и количества устройств, действующих к моменту времени t .

Пример 2. Время безотказной работы радиолампы определяется функцией надежности R(t) = (1/300) e-t/300 . Найти а) среднее значение времени работы; б) вероятность отказа за промежуток от 150 до 450 часов; в) вероятность работы не менее 600 часов. Решение.

а) Среднее время работы равно математическому ожиданию M(t) = 1/ = 300 часов;

б) P(150 < t < 450) = F(450) – F(150) = e-150/300 - e-450/300 =

в) Это значение функции надежности R(600) = e-600/300 = 1/e2 = 0.1352 .

5. Нормальное распределение (распределение Гаусса).

В правую часть диф. уравнения для показательного распределения введем дополнительный множитель (х – m) : df(x) / f(x) = -(x – m) dx . Это означает, что величина изменения плотности вероятности в окрестности точки х будет линейно зависеть и от смещения этой точки относительно некоторой точки m. Решение дифференциального. уравнения – f(x) = C

Это симметричная, быстро затухающая функция. Имеет куполообразную форму с вершиной при x = m и приводит к нормальному закону распределению СВ

( ( 5 )

( ( 5 )где а– определяет точку максимума и ось симметрии,

- расстояние от этой оси до точки перегиба или M(X) = а, D(X) = .

Особенности нормального распределения

а) Наиболее вероятны значения x, близкие к ожидаемому среднему значению а.

б) Отклонения от среднего значения а в обе стороны равновероятны.

в) Большие отклонения x от среднего значения а маловероятны.

Площадь под кривой Гаусса всегда равна единице, что соответствует полной вероятности. Поэтому при уменьшении увеличивается вероятность значений, близких к а, рассеяние уменьшается, кривая Гаусса сжимается. При увеличении график кривой Гаусса становится более расплывчатым, что говорит об увеличении рассеяния.

Это распределение играет фундаментальную роль в теории ошибок измерений. Согласно центральной предельной теореме закон распределения суммы большого числа независимых СВ, влияние каждого из которых на всю сумму ничтожно мало, близок к нормальному. Доказана А.М.Ляпуновым (1857 – 1918) .

Вероятности нормального распределения N(x; m, ) :

P(a< X < b) = F(b) - F(a) =

В случае m = 0, = 1 функция ( 6 ) наз. плотностью нормированного и центрированного распределения (локальная функция Лапласа)

а соответствующая функция распределения (х) =

наз. функцией Лапласа или интегралом вероятностей.

(x) - нечетная функция и вычисляется с помощью таблиц. После простой замены переменных в ( 6 ) имеем

P(a<X<b) = [

Вероятность отклонения Х от m на величину меньшую по симметричному участку относительно m равна

P(|X – m| < ) = P(m - < X < m + ) =

Пример 3. Определить среднее квадратичное отклонение случайных ошибок прибора, если они подчиняются нормальному закону. Систематических ошибок прибор не имеет (m = 0), а случайные с вероятностью 0,8 не выходят за пределы

Решение. По условию задачи Р( |x|

Пример 4. СВ Х распределена по нормальному закону с математиче6ским ожиданием m = 40 и дисперсией D = 160. Вычислить вероятность попадания СВ в интервал (30, 80)

Решение. В формуле ( 9 ) a = 30, b = 80, m = 40, =

P(30

Пример 5. Правило «трех сигм».

Вероятность того, что абсолютная величина отклонения «X–а» меньше , составляет (10):

В частности, если =3, получим:

Этот результат называют правилом «трех сигм»: почти достоверно (на 99,7%), что значения нормально распределенной случайной величины отличаются от своего среднего значения а менее, чем на 3, то есть практически все значения нормально распределенной случайной величины Х попадают в интервал: (а - 3; а+3), см. рис. 1.

Рис.1

;

;