теория вероятности. 1. Опыт с равновероятностными исходами. Вероятность и частота. Некоторые комбинаторные формулы

Скачать 1.11 Mb. Скачать 1.11 Mb.

|

|

Теорема. Для того, чтобы случ.вел-ны ξ и были независимыми, необходимо и достаточно, чтобы ф-ция распред.системы (ξ, η) была равна произведению ф-ций распределения составляющих Следствие. Для того, чтобы непрерывные случайные величины ξ и были независимыми, необходимо и достаточно, чтобы плотность совмест.распред.системы (ξ, η) была равна произведению плотностей распред.составляющих: (9.) Критерии независимости: 1) 2) Непрерывность 3) Дискретность Если хотя бы один из критериев не выполняется в любой одной точке, то величины ξ и η зависимы. 15. Условные распределения двумерной случайной величины. Функция распределения и её свойства. Условная плотность распределения и её свойства. Условные числовые характеристики. Корреляционные зависимости. Нормальный закон распределения двумерной случайной величины. Случайные величины: ξ xi i=1÷n; η yj j=1÷m. Условной функцией распределения случайной величины ξ, при условии, что случайная величина η приняла значение yi называется условная вероятность. Свойства условной ф-ции распределения: 1) Fξ(x|y) – определена для всех х 2) Fξ(x|y) [0,1] для всех х R 3) Fξ(-∞|y)=0 4) Fξ(+∞|y)=1 5) Сумма вероятностей распределения равна 1. Имеем yi: Имеем xi: Используют для контрольного вычисления. Условная плотность распределения и её свойства Условной плотностью распределения fξ(x/y) непрерывной случайной величины ξ при фиксированном значении η=у называется отношение плтности совместного распределения fξη(x/y) случайной величины (ξ,η) к плотности распределения случайной величины ξ.  Свойства: 1) fξ(x/y)≥0 2) fξ(x/y) – непрерывная функция 3) 4) ξ и η – независимы 5)  Условные числовые характеристики Условным мат ожиданием случайной величины ξ называют её мат ожидание, вычисленное при условии, что случайная величина η приняла значение у. Условное мат ожидание M[ξ|y] случайной величины ξ как функция параметра у называется регрессией ξ на у Смешанный начальный момента порядка K+S равен мат ожиданию  Смешанные центральный момент K+S равен мат ожиданию произведения центрированных величин  Следствия:  Корреляционные зависимости Корреляционным моментом (kξη) случайных величин ξ и η называют мат ожидание произведения отклонения этих величин от их мат ожидания: Характеризует степень тесноты линейных величин ξ и η и их рассеивание их значений относительно точки Свойства: 1) kξη = kηξ 2) Корреляционный момент двух независимых случайных величин ξ и η равен 0. 3)Абсолютная величина корреляционного момента двух случайных величин ξ и η не превышает среднего геометрического их дисперсий: Если kξη<0, то между ξ и η существует отрицательная корреляционная зависимость(если одно значение растет, то другое значение уменьшается). Если kξη >0, то между ξ и η существует положительная корреляционная зависимость(если одно значение растет, то и другое значение растет). Коэффициент корреляции (rξη) случайных величин ξ и η называется отношение корреляционного момента к произведению среднего квадратических отклонений этих величин: -1≤ rξη ≤1 Две случайные величины ξ и η называются коррелированными, если их корреляционный момент отличен от нуля. Соответственно, ξ и η называются некоррелированными, если их корреляционный момент равен нулю. rξη=1; ξ и η; η=аξ+b  Нормальный закон распределения двумерной случайной величины Непрерывная двумерная случайная величина (ξ,η) имеет нормальное распределение, если её плотность вероятности равна:  Параметрами нормального закона распределения являются: Если случайные величины распределены нормально, но они некоррелированны, то rξη=0, и получим:  Таким образом, если составляющие нормального распределенной случайной величины некоррелированны, то плотность совместного распределения системы равна произведению плотностей распределения составляющих. 16. Многомерные случайные величины.Основные характеристики (Ф-я распределения, плотность распр-я, понятие независимости). Основные числовые характеристики (мат.ожидание, дисперсия, корреляционная матрица, коэф-т корреляции, нормированная корреляционная матрица). Опр. Совокупность произвольного числа n одномерных случ. вел-н Опр. Ф-я распределения n-мерной случ. величины Опр. Плотность распред-я n-мерной случ. величины наз. смешанная частная производная функции распределения F(х1,х2,…,хn), взятая один раз по каждому аргументу. Св-ва плотности рапр-я: 1. f(x1,x2,…,xn) 0 2. 3. Плотности распределения меньшего порядка могут быть получены путем интегрирования n-мерной плотности распр-я по ненужным переменным. 4. Вер-ть попадания многомер.случ.величины Опр. Случайные величины f(x1,x2,…,xn)=f1(x1)f2(x2)…fn(xn) Основные числовые характеристики. 1. Вектор мат. ожидания. M=(m1,m2,…,mn) 2. Вектор дисперсии. D=(D1,D2,…,Dn) 3. Корреляционная матрица.  где kij=kji - т.е. матрица симметрична. Замечание: случ. величины 4. Коэф-т корреляции. 5. Корреляционная нормированная матрица  Rij=Rji Rij=RjiСлуч. величины ! Если случ. величины независимы, то они некоррелируемы, НО обратное утверждение НЕВЕРНО! Коэффициентом корреляции (rξη) случ вел ξ и η наз.отношение корреляц.момента к произведению среднеквадратич.отклонений этих величин -1≤ rξη ≤1 17. Основные задачи математической статистики. Генеральная и выборочная совокупность. Повторная и бесповторная выборка. Репрезентативность выборки. Теоретическая ФР. Статистическое распределение выборки. Эмпирическая функция распределения. Гистограмма, полигон относительных частот. Статистические оценки параметров распределения (выборочная, средняя, групповая и общая средняя, выборочная дисперсия). Формула для вычисления дисперсии. Статистика разрабатывает методы сбора данных и группировки по умолчанию. Задачи мат стат.: 1) указать способы сбора и группировки стат. сведений, полученных в рез-те наблюдения за случ. процессами; 2) разработка методов анализа стат. данных в зависимости от цели исследования. Генеральная и выборочная совокупность: Генеральной совокупностью опыта наз. множ-во объектов, из к-ых производится выборка. Выборочной совокупностью или просто выборкой наз. совокупность случайно отобранных объектов. {х1, х2, …, хn} n-объём выборки Объёмом совокупности (выборочной или генеральной) наз. число объектов этой совокупности. Повторная и бесповторная выборка. Репрезентативность выборки. Теоретическая ФР. Повторной наз.выборку, при к-ой отобранный объект (перед отбором следующего) возвращается в генеральную совокупность. Бесповторной наз.выборку, при к-ой отобранный объект в генеральную совокупность не возвращается. Выборка будет репрезентативной, если её осуществлять случайно, то есть каждый из объектов генеральной совокупности имеет одинаковую вероятность попасть в выборку. k-кол-во выборок, которые можно сделать n-объём выборки : ………………… Пусть Fξ(x) – функция распределения, тогда каждую из следующих выборок: можно рассмотреть как реализацию n-мерной случайной величины (ξ1, ξ2,…, ξn) Для всех ξi закон распределения единственный. Все компоненты (ξi) – независимы. Тогда F(х1,х2,…,хn)=F(x1)F(x2)…F(xn) Вариационным рядом наз.выборка В отличие от эмпирической функции распределения выборки функцию распределения F(x) генеральной совокупности наз. теоретической функцией распределения. Различие между эмпирической и теоретической функциями состоит в том,что теоретическая функция F(x) определяет вер-сть события X Статистическое распределение выборки: x1 – наблюдается n1 раз x2 – n2 xk – nk

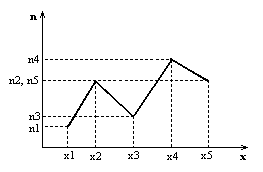

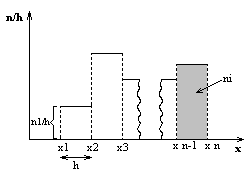

ni - частота Замечание: В теории вероятности под распределениями понимают соответствие между возможными значениями случ.величины и их вер-тями. А в мат.статистике – соответствие между наблюдаемыми вариантами и их частотами. Эмпирическая функция распределения: nx-число наблюдений, при которых наблюдалось значение признака варианты меньше, чем х n-общее число наблюдений (объём выборки) Эмперической функцией распределения случ.величины наз.функцию F*ξ(x), определяющую для каждого значения x относительную частоту событий:  Недостатки: Невысокая наглядность (визуально сложно определить закон распределения сл.величины ) Гистограмма и полигон относит.частот: Полигоном частот наз.ломаную, отрезки к-ой соединяют xi и ni.   Площадь гистограммы частот =сумме всех частот, то есть объёму выборки. |