|

|

Рабочая книга социолога. Вторая структура социологического знания общая социологическая теория

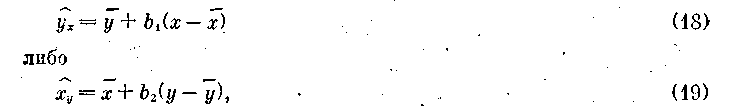

Меры взаимозависимости для интервального уровня измерения. Наиболее широко известной мерой связи служит коэффициент корреляций Пирсона (или, как его иногда называют, коэффициент корреляции, равный произведению моментов). Одно из важнейших предположений, на котором покоится использование коэффициента г, состоит в том, что регрессионные уравнения для изучаемых переменных имеют линейную форму23, т. е.

где у — среднее арифметическое для переменной у; х — среднее арифметическое для переменной х; b1и b2 - некоторые коэффициенты.

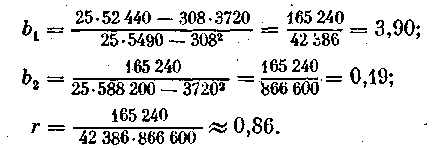

Поскольку вычисление коэффициента корреляции и коэффициентов регрессии b1 и b2 проводится по схожим формулам, то, вычисляя r, получаем сразу же и приближенные регрессионные модели24.

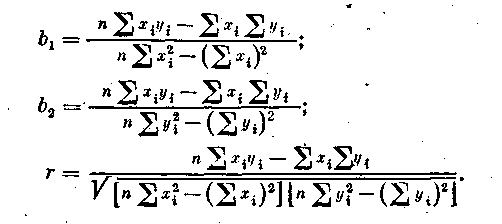

Выборочные коэффициенты регрессии и корреляции вычисляются по формулам

Здесь s2x —дисперсия признака х; s2x— дисперсия признака у.Величина sxy, называется ковариацией х и у.

Расчет r для не с группированных данных. Для вычислительных целей эти выражения в случае не сгруппированных данных можно переписать в следующем виде:

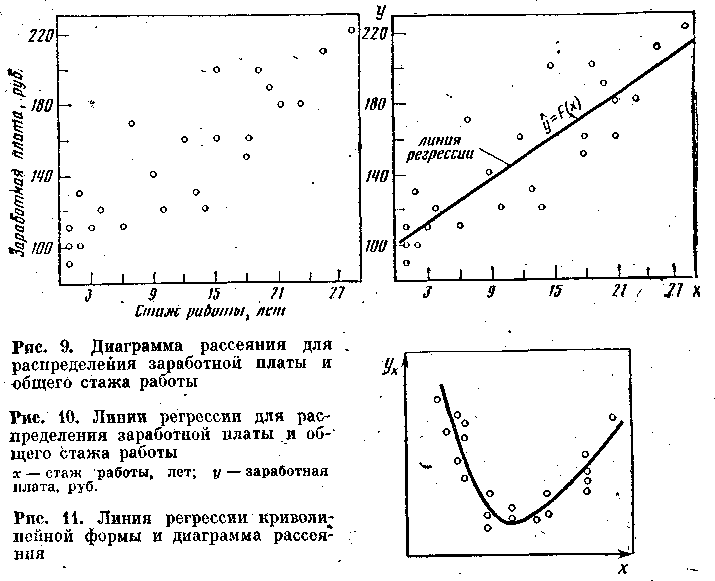

Рассчитаем коэффициент корреляции и коэффициенты регрессии для данных табл. 7:

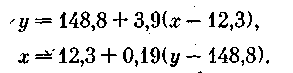

Тогда уравнение регрессии имеет вид

Линии регрессии y = F(x) изображены на рис. 10-. Отсюда видно, что между заработной платой и общим стажем работы существует прямая зависимость: по мере увеличения общего стажа работы на предприятии растет и заработная плата. Величина коэффициента корреляции довольно большая и свидетельствует о положительной связи между переменными величинами. Следует отметить, что вопрос о том, какую переменную в данном случае принимать в качестве зависимой величины, а какую — в качестве независимой, исследователь решает на основе качественного анализа и профессионального опыта. Коэффициент корреляции по определению является симметричным показателем связи: rxy = ryx. Область возможного изменения коэффициента корреляции г лежит в пределах от +1 до —1.

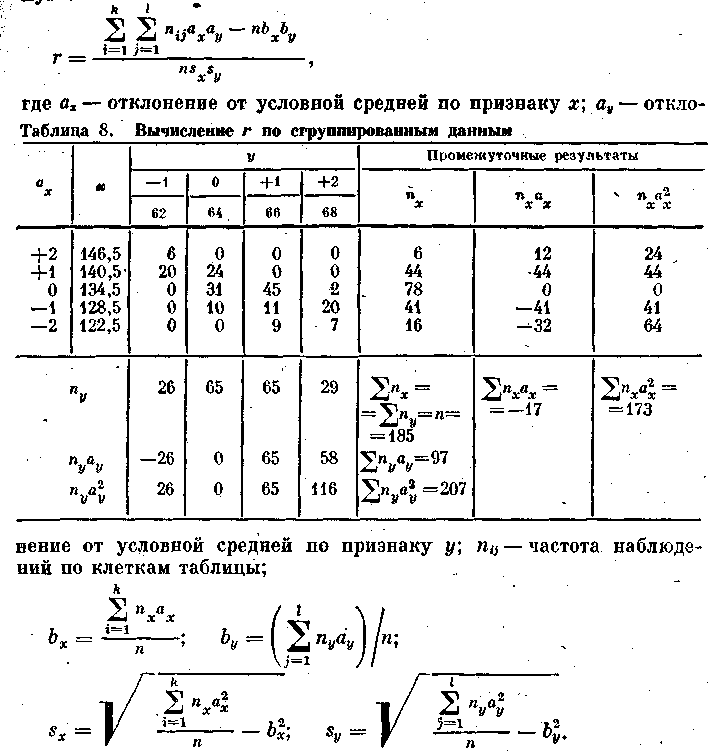

Вычисление r для сгруппированных данных. Для сгруппированных данных примем ширину интервала по каждой переменной за единицу (если по какой-либо переменной имеются неодинаковые размеры интервала, то возьмем из них наименьший). Выберем также начало координат для каждой переменной где-нибудь возле среднего значения, оцененного на глаз.

Для условных данных, помещенных в табл. 8, за нулевую точку отсчета выберем значение у, равное 64, а по x — значение 134,5.

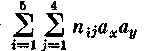

Тогда коэффициент корреляции определяется по следующей формуле:

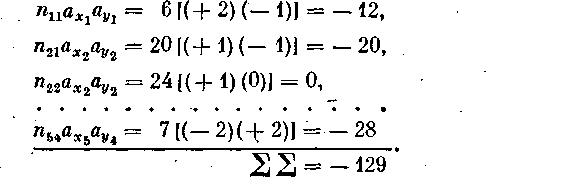

Для вышеприведенного примера порядок вычислений представлен в табл. 9. Для определения Snijaxby вычислим последовательно все произведения частоты в каждой клетке таблицы на ее координаты. Так

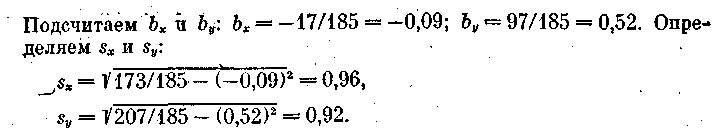

В соответствии с формулой вычисляем

Таким образом, величина связи достаточно велика, как, впрочем, и следовало ожидать на основе визуального анализа таблицы.

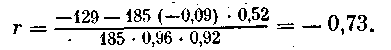

Статистическая значимость r. После вычисления коэффициента корреляции возникает вопрос, насколько показателен этот коэффициент и не обусловлена ли зависимость, которую он фиксирует, случайными отклонениями. Иначе говоря, необходимо проверить гипотезу о том, что полученное значение r значимо отличается от 0.

Если гипотеза H0 (r = 0) будет отвергнута, говорят, что величина коэффициента корреляции статистически значима (т. е. эта величина не обусловлена случайностью) при уровне значимости a.

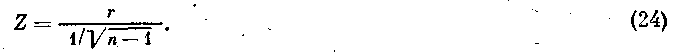

Для случая, когда п < 50, применяется критерий t, вычисляемый по формуле

Распределение t дано в табл. В приложения.

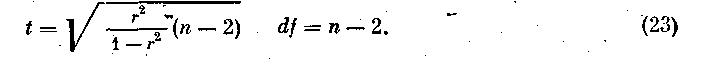

Если п > 50, то необходимо использовать Z-критерий

В табл. А приложения приведены значения величины ZKpдля соответствующих a.

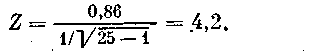

Вычислим величину Z для коэффициента корреляции по табл. 7 (вычисление проделаем лишь для иллюстрации, так как число наблюдений п — 25 и нужно применять критерий t). Величина r (см. табл. 7) равна 0,86. Тогда

Для уровня значимости a = 0,01 ZKp = 2,33 (см. табл. А приложения).

Поскольку Z > ZKp, мы должны констатировать, что коэффициент корреляции г = 0,86 значим и лишь в 1 % случаев может оказаться равным нулю. Аналогичный результат дает и проверка по критерию t для а = 0,01 (односторонняя область); tкр— 2,509, tвыборочное равно 8,08.

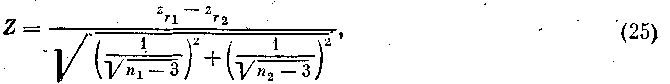

Другой часто встречающейся задачей, является проверка равенства на значимом уровне двух коэффициентов корреляции. i = г2 при заданном уровне а, т. е. различия между r1 и r2 обусловлены лишь колебаниями выборочной совокупности.

Критерий для проверки значимости следующий:

где значения zrj и zrнаходят по табл. Д приложения для r1 и r2.

Значения ZКp определяют по табл. А. приложения аналогично вышеприведенному примеру.

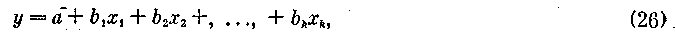

Частная и множественная регрессия и корреляция. Ранее нами было показано, как можно по опытным данным найти зависимость одной переменной от другой, а именно как построить уравнение регрессии вида у = а + bх. Если исследователь изучает влияние нескольких переменных х1, х2, ..., хk результатирующий признак y, то возникает необходимость в умении строить регрессионное уравнение более общего вида, т. е.

где a, b1,. b2, ..., bk— постоянные коэффициенты, коэффициенты регрессии.

В связи с уравнением (26) необходимо рассмотреть следующие вопросы: а) как по эмпирическим данным вычислить коэффициенту регрессии а, b1, b2…bк ; б)какую интерпретацию можно приписать этим коэффициентам; в) оценить тесноту связи между у и каждым из Xi в отдельности (при элиминировании действия остальных); г) оценить тесноту связи между у и всеми переменными х1, ..., xкв совокупности.

Рассмотрим этот вопрос на примере построения двухфакторного регрессионного уравнения. Предположим, что изучается зависимость недельного бюджета свободного времени (у) от уровня образования (хi) и возраста (х2) определенной группы трудящихся по данным выборочного обследования. Будем искать эту зависимость в виде линейного уравнения следующего вида:

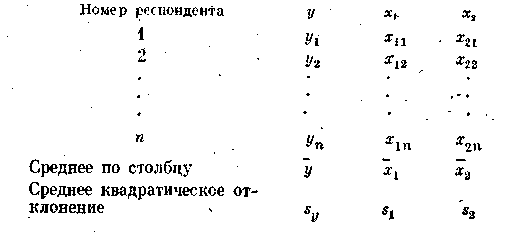

При расчете коэффициентов уравнения множественной регрессии полезно преобразовать исходные эмпирические данные следующим образом. Пусть в результате обследования п человек получены эмпирические значения, сведенные в следующую таблицу (в каждом столбце представлены не сгруппированные данные):

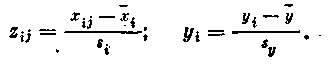

Каждое значение переменной в таблице преобразуем по формулам

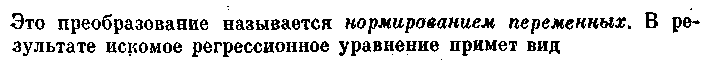

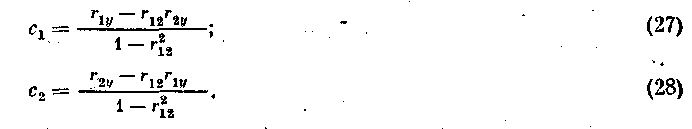

Коэффициенты с1 и сгнаходятся по следующим формулам

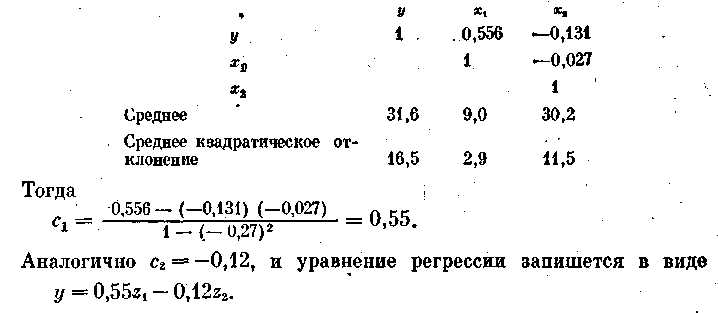

с1 и с2 называются стандартизированными коэффициентами регрессии. Следовательно, зная коэффициенты корреляции между изучаемыми признаками, можно подсчитать коэффициенты регрессии. Подставим конкретные значения rij из следующей таблицы25;

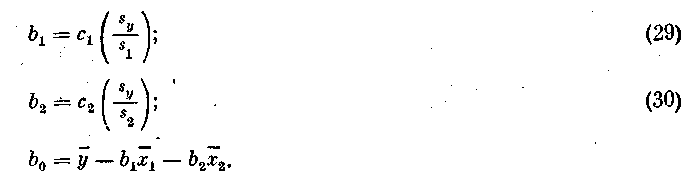

Коэффициенты исходного регрессионного уравнения b0, b1 и b2 находятся по формулам

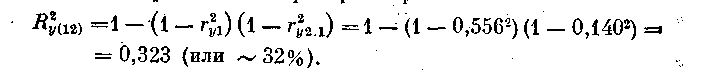

Подставляя сюда данные из вышеприведенной таблицы, получим b1= 3,13; b2= -0,17; b0= - 8,56.

Как же следует интерпретировать это уравнение? Например, значение b2показывает, что в среднем недельный бюджет свободного времени при увеличении возраста на один год и при фиксированном признаке Xi уменьшается на 0,17 час. Аналогично интерпретируется b1. (Исходные эмпирические данные можно изобразить на диаграмме рассеяния аналогично тому, как это сделано на рис. 10, но уже в трехмерном пространстве (у, xt, х2).

Коэффициенты х1 и х2 можно в то же время рассматривать и как показатели тесноты связи между переменными у и, например, Xi при постоянстве хг.

Аналогичную интерпретацию можно применять и к стандартизированным коэффициентам регрессии сi. Однако поскольку ciвычисляются исходя из нормированных переменных, они являются безразмерными и позволяют сравнивать тесноту связи между переменными, измеряемыми в различных единицах. Например, в вышеприведенном примере Xi измеряется в классах, a x2 — в годах. C1и с2 позволяют сравнить, насколько z1 теснее связан с у, чем хг26.

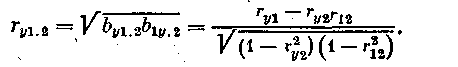

Поскольку коэффициенты biи сi измеряют частную одностороннюю связь, возникает необходимость иметь показатель, характеризующий связь в обоих направлениях. Таким показателем является частный коэффициент корреляции

Для рассматриваемого примера ry1.2 = 0,558, rу2.1 i = —0,140.

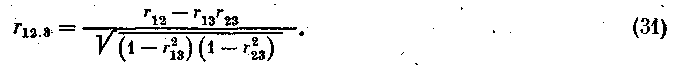

Для любых трех переменных x1, х2, х3частный коэффициент корреляции между двумя из них при элиминировании третьей строится следующим образом:

Аналогично можно определить и частные коэффициенты корреляции для большего числа переменных (r12, 34 ...). Однако ввиду громоздкости вычисления они применяются достаточно редко.

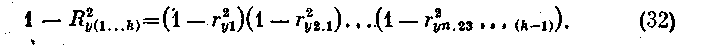

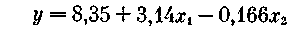

Для характеристики степени связи результатирующего признака у с совокупностью независимых переменных служит множественный коэффициент корреляции R2y, который вычисляется по формуле (иногда он выражается в процентах)

Так, для вышеприведенного примера он равен

Множественный коэффициент корреляции показывает, что включение признаков х1и х2в уравнение

на 32% объясняет изменчивость результатирующего фактора. Чем больше Rt, тем полнее независимые переменные х2..., xkописывают признак у. Обычно служит критерием включения или исключения новой переменпой в регрессионное уравнение. Если Л мало изменяется при включении новой переменной в уравнение, то такая переменная отбрасывается.

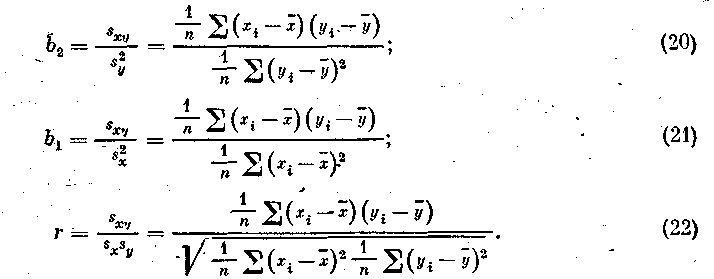

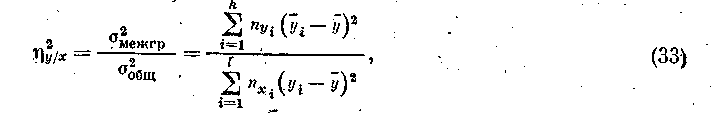

Корреляционное отношение. Наиболее общим показателем связи при любой форме зависимости между переменными является корреляционное отношение h2. Корреляционное отношение h2у/хопределяется через отношение межгрупповой дисперсии к общей дисперсии по признаку у:

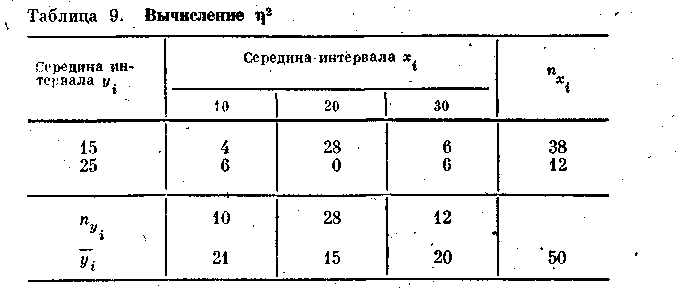

где уi — среднее значение i-ro y-сечения (среднее признака у для объектов, у которых x=xi, т. е. столбец «г»); xi —среднее значение i-го x-сечения т. е. строка «i» nyi —число наблюдений в y сечении; nXi— число наблюдений в x-сечении; у — среднее значение у.

Величина h2у/хпоказывает, какая доля изменчивости значений у обусловлена изменением значения х. В отличие от коэффициента корреляции h2у/х не является симметричным показателем связи, т. е, h2у/х не равно h2х/y. Аналогично определяется корреляционное отношение х по у27.

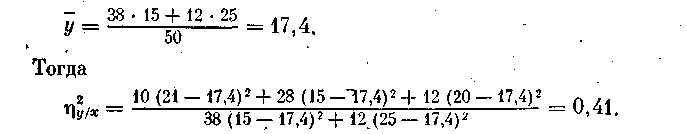

Пример. По данным таблицы сопряженности (табл. 9) найдем h2у/х. Вычислим общую среднюю

Сравнение статистических показателей r и h2у/х. Приведем сравнительную характеристику коэффициента корреляции (будем сравнивать r2) и корреляционного отношения h2у/х.

а) r2 = 0, если x и у независимы (обратное утверждение неверно);

б) r2 =h2у/х =1 тогда и только тогда, когда имеется строгая линейная функциональная зависимость у от х.

в) r2 = r\y/x<i тогда и только тогда, когда регрессия х и у строго линейна, но нет функциональной зависимости;

г) r2 <h2у/х< 1 указывает на то, что нет функциональной зависимости и существует нелинейная кривая регрессии.

Коэффициенты взаимозависимости для порядкового

уровня измерения.

К этой группе относятся коэффициенты ранговой корреляции Спирмена rа, Кендалла t и g. Коэффициенты ранговой корреляции используются для измерения взаимозависимости между качественными признаками, значения-которых могут быть упорядочены или проранжированы по степени убывания (или нарастания) данного качества у исследуемых социальных объектов.

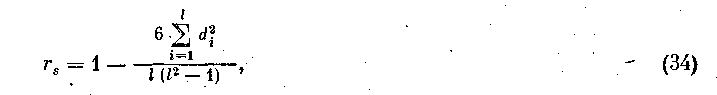

Коэффициент ранговой корреляции Спирмена rs. Этот коэффициент вычисляется по следующей формуле:

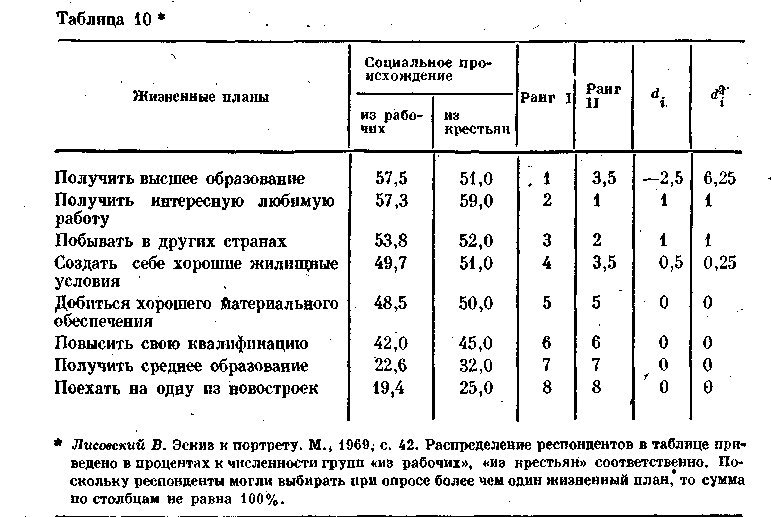

где di = i — ki— разность между i-ми парами рангов; I — число сопоставляемых пар рангов. Величина rs может изменяться в пределах от +1 до — 1, когда два ряда проранжированы в одном порядке. При полном взаимном беспорядочном расположении рангов г, равен нулю. Пример. По данным табл. 10 выясним, в какой степени связаны жизненные планы детей, отличающихся по социальному происхождению. Для этого проранжируем значения процентных распределений для каждой из двух групп детей.

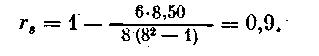

В графе «из крестьян» (табл. 10) встречаются два одинаковых числа (51, 0). В подобных случаях обоим числам присваивают ранг, равный среднему арифметическому из этих рангов, т. е. (3 + 4)/2 = 3,5. Подставляя промежуточные величины, вычисленные в табл. 10, в формулу (34), находим28

Такую величину r, можно интерпретировать как высокую степень связи между жизненными планами детей рабочих и крестьян. Однако большая величина г, не должна скрывать тот факт, что жизненные планы молодежи в табл. 10 распадаются на две группы. Для одной группы (нижняя часть таблицы) ранги полностью совпадают, а для другой (верхняя часть) — нет.

Если подсчитать rs, для каждой группы отдельно, то в первом случае, очевидно, rs= 1, а во втором rs=0,15, но статистически незначимо отличается от 0.

Значимость коэффициента корреляции Спирмена для l < 100 можно определить по табл. Г приложения, где приведены критические величины rs.

Если l> 100, то критические значения находятся по табл. А формуле

Например, возвращаясь к данным табл. 10, где l< 100, по табл. Г приложения найдем, что для того, чтобы rбыл значим на уровне 0,01, он должен быть равен или превосходить 0,833. Эмпирическое значение r, = 0,9, и поэтому делается вывод, что имеется значимая связь между предпочтениями жизненных планов двух групп респондентов. Аналогичным образом легко убедиться, что rs, = 0,15 при l= 4 статистически незначим.

Коэффициент ранговой корреляции t Кендалла. Подобно rs коэффициент Кендалла используется для измерения взаимосвязи между качественными признаками, характеризующими объекты одной и той же природы, ранжированные по одному и тому же критерию, т изменяется от +1 до —1. Для расчета t0 используется формула

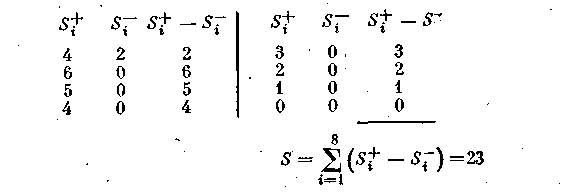

Как вычисляется S, поясним на примере данных табл. 10.

Таблица упорядочена так, что в графе «Ранг I» ранги расположились в порядке возрастания их значений. Берем значение ранга, стоящего в графе «Ранг II» на первом месте, 3,5; из расположенных ниже данного ранга семи других четыре значения его превышают, а два — меньше его. Число 4 записывается в графу Si , a 2 в колонку Si. Аналогичный подсчет делается для второго ранга со значением 1. Число рангов, расположенных ниже данного значения и превышающих его, равно 6, а число рангов, меньших данного,— 0 и т. д. Остальные вычисления ясны из следующей таблицы:

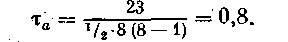

Тогда, подставив соответствующие значения в формулу (36), получим

Таким образом, tа дает более осторожную оценку для степени связи двух признаков, чем rs.

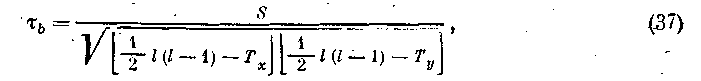

При расчете t не учитывались равные ранги. Например, в табл. 10 имеются два равных ранга со значением 3,5. Если число равных рангов велико, то необходимо вычислить т по следующей формуле:

где Тх= i/2Ztx(tx—i) (tx—число равных рангов по первой переменной); Ту=i/2Zty(tv—i) (ty — число равных рангов по второй: переменной).

Для предыдущего примера tx= 1, tv=2,тогда Тх = 0, Ty = 1.

Значимость коэффициента корреляции Кендалла t при l > 10 определяется по формуле

Гипотеза о том, что tа = 0, будет отвергнута для данного а, если |Z|>Zкр(a/2).

Для вышеприведенного примера ,

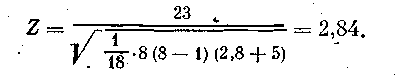

По табл. А приложения для а = 0,05 находим ZKp(a/2), равное 1,96. Поскольку расчетное значение 2 = 2,84 и, следователыю, больше Zкр, заключаем с вероятностью 95%, что t не равно 0.

Коэффициенты корреляции Спирмена и Кендалла используются как меры взаимозависимости между рядами рангов, а не как меры связи между самими переменными. Так, в табл. 10 ранги отражают иерархию жизненных планов, но совершенно не говорят о том, что дети рабочих почти в равной мере хотят получить как высшее образование, так и интересную работу (разница 0,2%), а дети крестьян в большей степени стремятся к высшему образованию (разница 8%). Кроме того, какая-нибудь из групп респондентов может считать, что выделенные категории вообще не отражают их жизненных планов, по проранжировали предложенные варианты. Если для целей исследования можно предположить эти моменты несущественными, то оправданно применение ранговой корреляции.

Коэффициенты Спирмена и Кендалла обладают примерно одинаковыми свойствами, но в случае многих рангов, а также при введении дополнительных объектов в ходе исследования имеет определенные вычислительные преимущества29.

Другая мера связи между двумя упорядоченными переменными — g. Она, так же как и предыдущие коэффициенты, изменяется

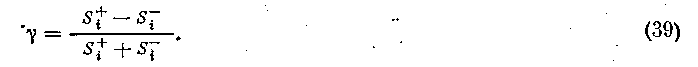

от +1 до — 1 и может быть подсчитана при любом числе связанных рангов. Формула для вычисления g записывается в виде

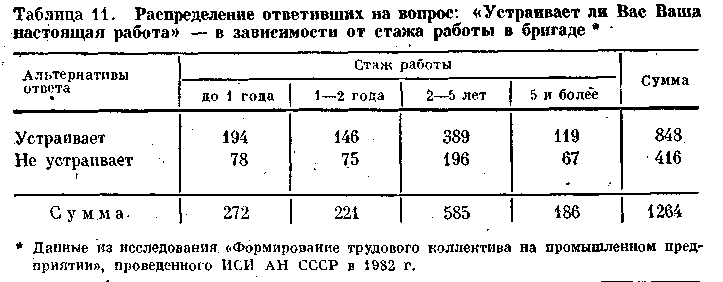

Для иллюстрации правил вычисления 5, по сгруппированным данным обратимся к примеру (табл. 11).

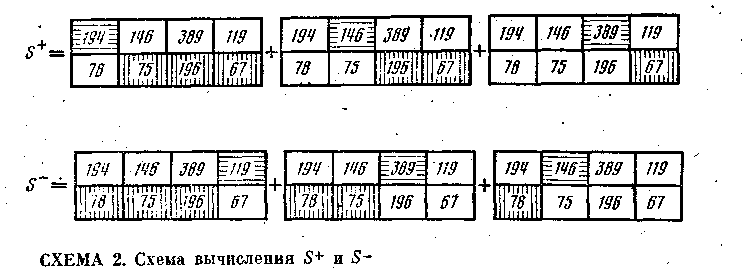

Процесс вычисления S+и S

наглядно представлен на схеме

(схема 2).

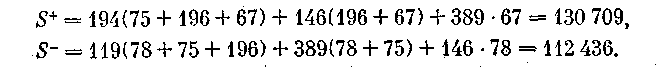

Так:

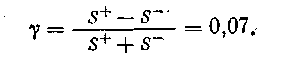

Подставляя эти величины в формулу для g, находим

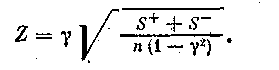

Проверку статистической значимости проводят по формуле

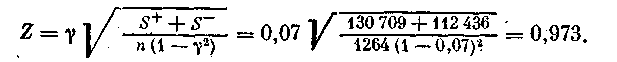

Гипотеза Н0оравенстве нулю коэффициента отвергается, если Z>ZKр(a/2). Для наших данных

Для а = 0,05 по табл. А приложения ZKp(a/2) = 1,96. Таким образом, Z < ZKp, и, следовательно, у нас нет оснований отвергнуть гипотезу Н0 : g= 0, т. е. лишь в 5 % случаев следует ожидать, что gбудет отличен от нуля.

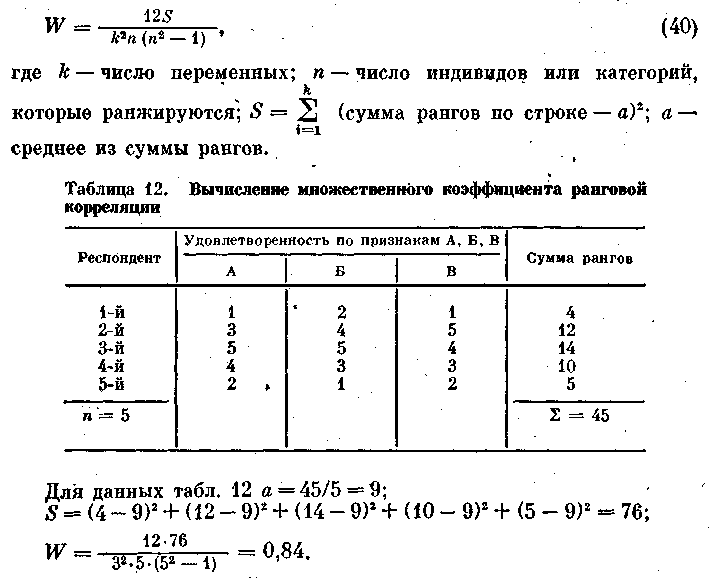

Множественный коэффициент корреляции W. Этот коэффициент, иногда называемый коэффициентом конкордации, используется для измерения степени согласованности двух или нескольких рядов проранжированных значений переменных.

Коэффициент W вычисляется по формуле

Значимость полученной величины W для и > 7 проверяется по критерию c2:

со степенью свободы п — 1. Для примера c2 = 10,133, степень свободы (n— 1)=4. Для a= 0,05 из табл. Б приложения находим c2 = 9,488. Поскольку наблюдаемое значение c2 больше критической точки, отвергаем гипотезу о том, что не существует значимой связи между рассматриваемыми переменными30.

|

|

|

Скачать 3.63 Mb.

Скачать 3.63 Mb.