Курсовая работа СМО Гангур. Курсовая работа методы решения задач оптимизации по дисциплине Методы оптимизации Направление подготовки

Скачать 490.03 Kb. Скачать 490.03 Kb.

|

Пример 2 Matlab.Данные, находящиеся в файле table.txt, предоставлены в (таблице 3.)

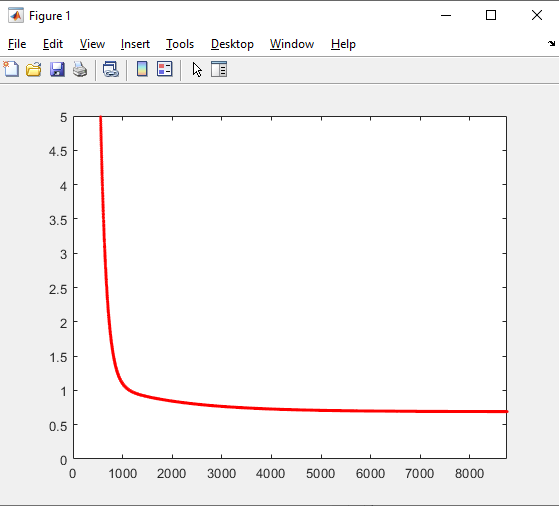

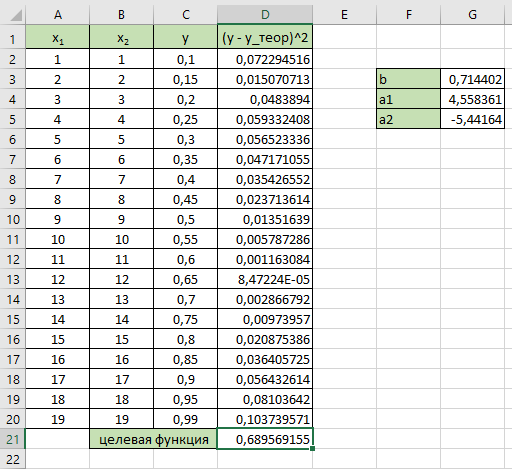

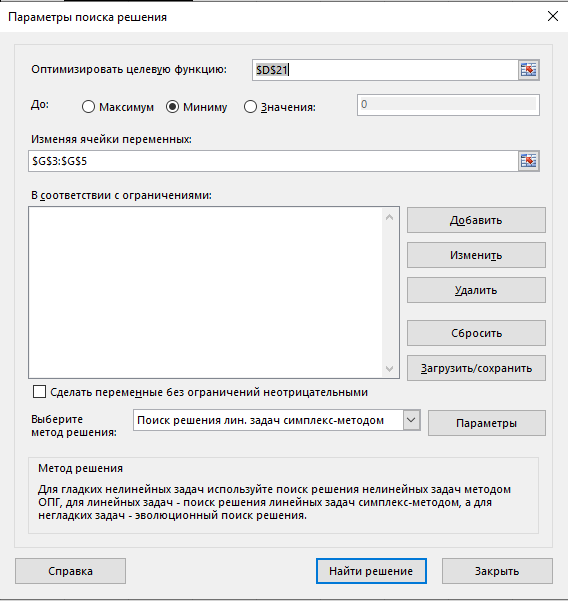

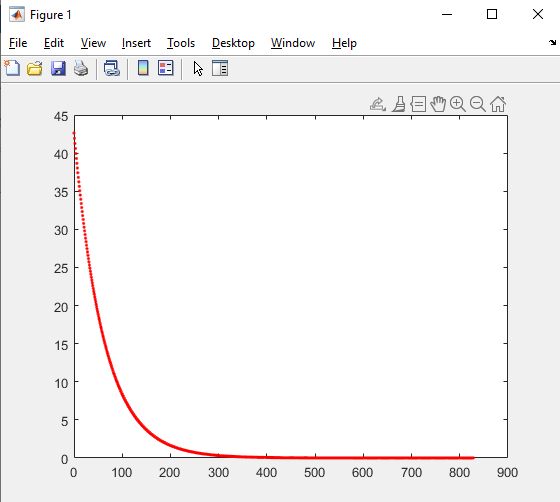

Таблица 3 – Исходные данные. Для данного примера были заданы следующие начальные параметры:     Получены следующие результаты: b=0.722465 a1=4.538736 a2=-5.461264 Количество итераций: 8746 Сумма квадратов отклонений равна: 0.691013 Коэффициент детерминации равен: 0.512029 >>  Рисунок 12 – Сумма квадратов отклонений. Из полученных результатов можно составить уравнение регрессионной модели:  Пример 2 Excel.Для реализации решения другим инструментальным средством будет использоваться Excel. Заполняем ячейки Excel исходными данными, а затем на их основе формируем сумму квадратов отклонений и целевую функцию (в ячейке D21 находится целевая функция, а все что выше – квадраты отклонений для каждого исходного данного).  Рисунок 13 – Таблица Excel. Вызываем “Поиск решения”, указываем все необходимое, нажимаем “найти решение” и получаем ответ.  Рис.14 – “Поиск решения”. В результате работы Excel получаем следующую функцию:

Таблица 4 – сравнение Matlab и Excel. Сравнивая результаты, мы видим, что данные практически совпадают. Matlab справился с работой чуть лучше. Пример 3 Matlab.Данные, находящиеся в файле table.txt, предоставлены в (таблице 5.)

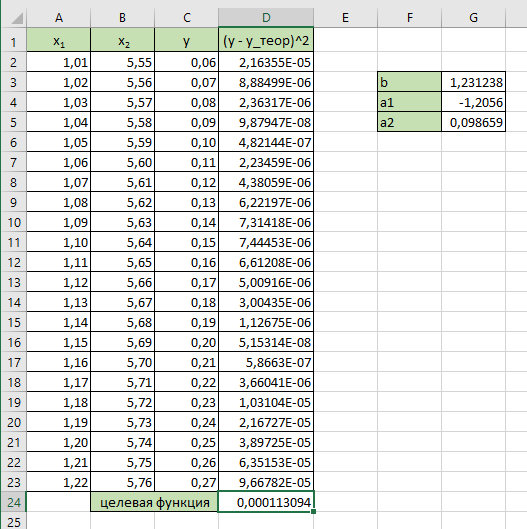

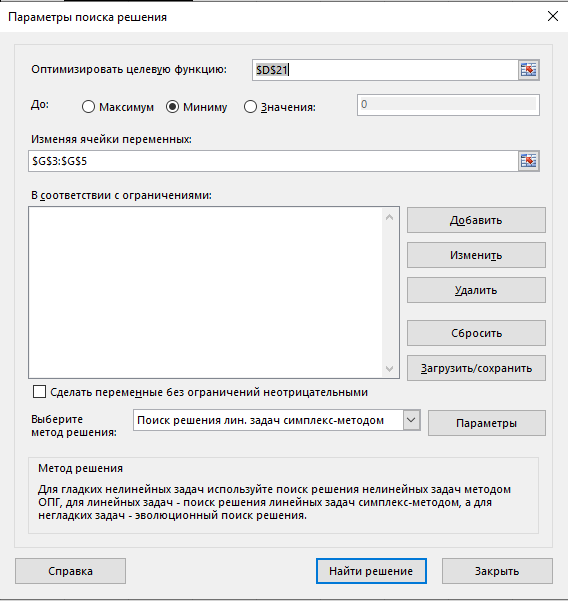

Таблица 5 - Исходные данные. Для данного примера были заданы следующие начальные параметры:     Получены следующие результаты: b=1.239551 a1=-1.185663 a2=-0.034547 Количество итераций: 828 Сумма квадратов отклонений равна: 0.000406 Коэффициент детерминации равен: 0.995414 >>  Рисунок 15 – Сумма квадратов отклонений. Из полученных результатов можно составить уравнение регрессионной модели:  Пример 3 Excel.Для реализации решения другим инструментальным средством будет использоваться Excel. Заполняем ячейки Excel исходными данными, а затем на их основе формируем сумму квадратов отклонений и целевую функцию (в ячейке D21 находится целевая функция, а все что выше – квадраты отклонений для каждого исходного данного).  Рисунок 16 – Таблица Excel. Вызываем “Поиск решения”, указываем все необходимое, нажимаем “найти решение” и получаем ответ.  Рисунок 17– “Поиск решения”. В результате работы Excel получаем следующую функцию:

Таблица 6 – сравнение Matlab и Excel. Сравнивая результаты, мы видим, что данные практически совпадают. Excel справился с работой лучше. Заключение.В ходе выполнения курсовой работы были изучены два метода оптимизации – метод идеальной точки и метод простого градиентного спуска. Были изучены теоретические аспекты обоих методов, а также применение их на практике для решения различных задач с использование различного программного обеспечения. Метод идеальной точки был реализован без использования сторонних программируемых приложений. Метод градиентного спуска был реализован в среде Matlab и результаты, полученные с помощью него, были проверены при помощи Microsoft Excel и его инструментария в виде “Поиска решений”. |