Моделирование Лузина. Виды (направления) прогнозирования

Скачать 1.58 Mb. Скачать 1.58 Mb.

|

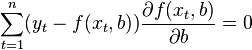

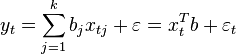

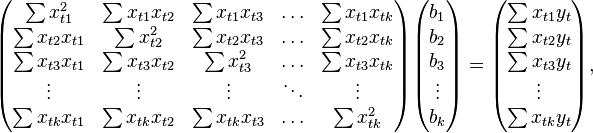

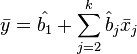

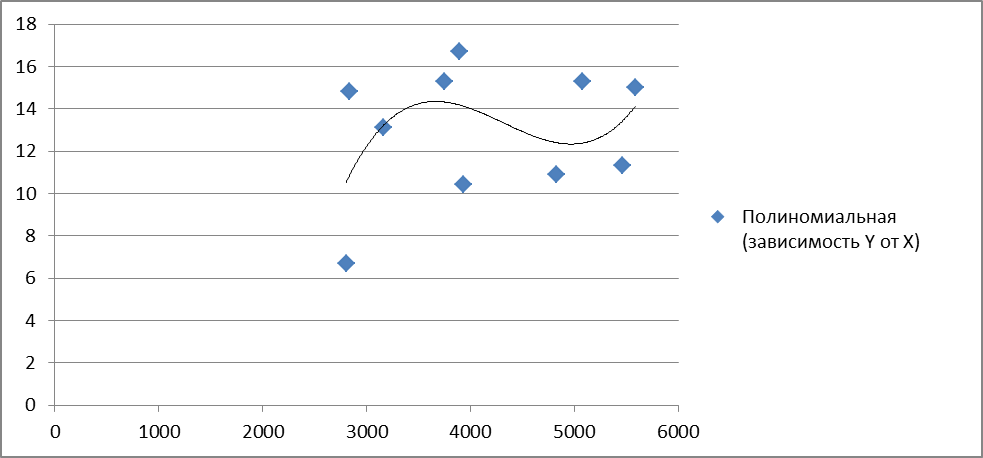

Пример — система линейных уравнений[править|править вики-текст]В частности, метод наименьших квадратов может использоваться для «решения» системы линейных уравнений , где матрица не квадратная, а прямоугольная размера (точнее ранг матрицы A больше количества искомых переменных). Такая система уравнений, в общем случае не имеет решения. Поэтому эту систему можно «решить» только в смысле выбора такого вектора , чтобы минимизировать «расстояние» между векторами и . Для этого можно применить критерий минимизации суммы квадратов разностей левой и правой частей уравнений системы, то есть Используя оператор псевдоинверсии, решение можно переписать так: , где — псевдообратная матрица для . Данную задачу также можно «решить» используя так называемый взвешенный МНК (см. ниже), когда разные уравнения системы получают разный вес из теоретических соображений. Строгое обоснование и установление границ содержательной применимости метода даны А. А. Марковым и А. Н. Колмогоровым. Пусть имеется значений некоторой переменной (это могут быть результаты наблюдений, экспериментов и т. д.) и соответствующих переменных . Задача заключается в том, чтобы взаимосвязь между и аппроксимировать некоторой функцией , известной с точностью до некоторых неизвестных параметров , то есть фактически найти наилучшие значения параметров , максимально приближающие значения к фактическим значениям . Фактически это сводится к случаю «решения» переопределенной системы уравнений относительно : В регрессионном анализе и в частности в эконометрике используются вероятностные модели зависимости между переменными где — так называемые случайные ошибки модели. Соответственно, отклонения наблюдаемых значений от модельных предполагается уже в самой модели. Сущность МНК (обычного, классического) заключается в том, чтобы найти такие параметры , при которых сумма квадратов отклонений (ошибок, для регрессионных моделей их часто называют остатками регрессии) будет минимальной: где — англ. ResidualSumofSquares[4] определяется как: В общем случае решение этой задачи может осуществляться численными методами оптимизации (минимизации). В этом случае говорят о нелинейном МНК(NLS или NLLS — англ. Non-LinearLeastSquares). Во многих случаях можно получить аналитическое решение. Для решения задачи минимизации необходимо найти стационарные точки функции  . .Пусть регрессионная зависимость является линейной:  . .Пусть y — вектор-столбец наблюдений объясняемой переменной, а — это -матрица наблюдений факторов (строки матрицы — векторы значений факторов в данном наблюдении, по столбцам — вектор значений данного фактора во всех наблюдениях). Матричное представление линейной модели имеет вид: . Тогда вектор оценок объясняемой переменной и вектор остатков регрессии будут равны соответственно сумма квадратов остатков регрессии будет равна Дифференцируя эту функцию по вектору параметров и приравняв производные к нулю, получим систему уравнений (в матричной форме): В расшифрованной матричной форме эта система уравнений выглядит следующим образом:  где все суммы берутся по всем допустимым значениям . где все суммы берутся по всем допустимым значениям .Если в модель включена константа (как обычно), то при всех , поэтому в левом верхнем углу матрицы системы уравнений находится количество наблюдений , а в остальных элементах первой строки и первого столбца — просто суммы значений переменных: и первый элемент правой части системы — . Решение этой системы уравнений и дает общую формулу МНК-оценок для линейной модели: Для аналитических целей оказывается полезным последнее представление этой формулы (в системе уравнений при делении на n, вместо сумм фигурируют средние арифметические). Если в регрессионной модели данные центрированы, то в этом представлении первая матрица имеет смысл выборочной ковариационной матрицы факторов, а вторая — вектор ковариаций факторов с зависимой переменной. Если кроме того данные ещё и нормированы на СКО (то есть в конечном итоге стандартизированы), то первая матрица имеет смысл выборочной корреляционной матрицы факторов, второй вектор — вектора выборочных корреляций факторов с зависимой переменной. Немаловажное свойство МНК-оценок для моделей с константой — линия построенной регрессии проходит через центр тяжести выборочных данных, то есть выполняется равенство:  . .В частности, в крайнем случае, когда единственным регрессором является константа, получаем, что МНК-оценка единственного параметра (собственно константы) равна среднему значению объясняемой переменной. То есть среднее арифметическое, известное своими хорошими свойствами из законов больших чисел, также является МНК-оценкой — удовлетворяет критерию минимума суммы квадратов отклонений от неё. В случае парной линейной регрессии Отсюда несложно найти оценки коэффициентов:  Несмотря на то что в общем случае модели с константой предпочтительней, в некоторых случаях из теоретических соображений известно, что константа должна быть равна нулю. Например, в физике зависимость между напряжением и силой тока имеет вид ; замеряя напряжение и силу тока, необходимо оценить сопротивление. В таком случае речь идёт о модели . В этом случае вместо системы уравнений имеем единственное уравнение Следовательно, формула оценки единственного коэффициента имеет вид В первую очередь, отметим, что для линейных моделей МНК-оценки являются линейными оценками, как это следует из вышеприведённой формулы. Длянесмещенности МНК-оценок необходимо и достаточно выполнения важнейшего условия регрессионного анализа: условное по факторам математическое ожидание случайной ошибки должно быть равно нулю. Данное условие, в частности, выполнено, если математическое ожидание случайных ошибок равно нулю, и факторы и случайные ошибки — независимые случайные величины. Первое условие можно считать выполненным всегда для моделей с константой, так как константа берёт на себя ненулевое математическое ожидание ошибок (поэтому модели с константой в общем случае предпочтительнее). Второе условие — условие экзогенности факторов — принципиальное. Если это свойство не выполнено, то можно считать, что практически любые оценки будут крайне неудовлетворительными: они не будут даже состоятельными (то есть даже очень большой объём данных не позволяет получить качественные оценки в этом случае). В классическом случае делается более сильное предположение о детерминированности факторов, в отличие от случайной ошибки, что автоматически означает выполнение условия экзогенности. В общем случае для состоятельности оценок достаточно выполнения условия экзогенности вместе со сходимостью матрицы к некоторой невырожденной матрице при увеличении объёма выборки до бесконечности. Для того, чтобы кроме состоятельности и несмещенности, оценки (обычного) МНК были ещё и эффективными (наилучшими в классе линейных несмещенных оценок) необходимо выполнение дополнительных свойств случайной ошибки: Постоянная (одинаковая) дисперсия случайных ошибок во всех наблюдениях (отсутствие гетероскедастичности): Отсутствие корреляции (автокорреляции) случайных ошибок в разных наблюдениях между собой Данные предположения можно сформулировать для ковариационной матрицы вектора случайных ошибок Линейная модель, удовлетворяющая таким условиям, называется классической. МНК-оценки для классической линейной регрессии являютсянесмещёнными, состоятельными и наиболее эффективными оценками в классе всех линейных несмещённых оценок (в англоязычной литературе иногда употребляют аббревиатуру BLUE (Best Linear Unbiased Estimator) — наилучшая линейная несмещённая оценка; в отечественной литературе чаще приводится теорема Гаусса — Маркова). Как нетрудно показать, ковариационная матрица вектора оценок коэффициентов будет равна: Эффективность означает, что эта ковариационная матрица является «минимальной» (любая линейная комбинация коэффициентов, и в частности сами коэффициенты, имеют минимальную дисперсию), то есть в классе линейных несмещенных оценок оценки МНК-наилучшие. Диагональные элементы этой матрицы — дисперсии оценок коэффициентов — важные параметры качества полученных оценок. Однако рассчитать ковариационную матрицу невозможно, поскольку дисперсия случайных ошибок неизвестна. Можно доказать, что несмещённой и состоятельной (для классической линейной модели) оценкой дисперсии случайных ошибок является величина: Подставив данное значение в формулу для ковариационной матрицы и получим оценку ковариационной матрицы. Полученные оценки также являютсянесмещёнными и состоятельными. Важно также то, что оценка дисперсии ошибок (а значит и дисперсий коэффициентов) и оценки параметров модели являются независимыми случайными величинами, что позволяет получить тестовые статистики для проверки гипотез о коэффициентах модели. Необходимо отметить, что если классические предположения не выполнены, МНК-оценки параметров не являются наиболее эффективными оценками (оставаясь несмещёнными и состоятельными). Однако, ещё более ухудшается оценка ковариационной матрицы — она становится смещённой инесостоятельной. Это означает, что статистические выводы о качестве построенной модели в таком случае могут быть крайне недостоверными. Одним из вариантов решения последней проблемы является применение специальных оценок ковариационной матрицы, которые являются состоятельными при нарушениях классических предположений (стандартные ошибки в форме Уайта и стандартные ошибки в форме Ньюи-Уеста). Другой подход заключается в применении так называемого обобщённого МНК. Метод наименьших квадратов допускает широкое обобщение. Вместо минимизации суммы квадратов остатков можно минимизировать некоторую положительно определенную квадратичную форму от вектора остатков , где — некоторая симметрическая положительно определенная весовая матрица. Обычный МНК является частным случаем данного подхода, когда весовая матрица пропорциональна единичной матрице. Как известно из теории симметрических матриц (или операторов) для таких матриц существует разложение . Следовательно, указанный функционал можно представить следующим образом Доказано (теорема Айткена), что для обобщенной линейной регрессионной модели (в которой на ковариационную матрицу случайных ошибок не налагается никаких ограничений) наиболее эффективными (в классе линейных несмещенных оценок) являются оценки т. н. обобщенного МНК — LS-метода с весовой матрицей, равной обратной ковариационной матрице случайных ошибок: . Задание 2. Методические основы моделирования и прогнозирования: графическое и аналитическое изучение взаимосвязей По приведенным в таблицах данным (номера таблиц соответствуют значению α, представлены в табл. 3.2) построить диаграммы, показывающие зависимость каждого из показателей от времени (x – t, y – t) и друг от друга (х – у). По каждой диаграмме определить вид зависимости и рассчитать коэффициенты корреляции и детерминации. Сделать выводы. Таблица 4.8 Данные об уровне рентабельности сельхозпредприятий (Х) и размерах среднемесячной заработной платы работников (Y)

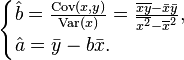

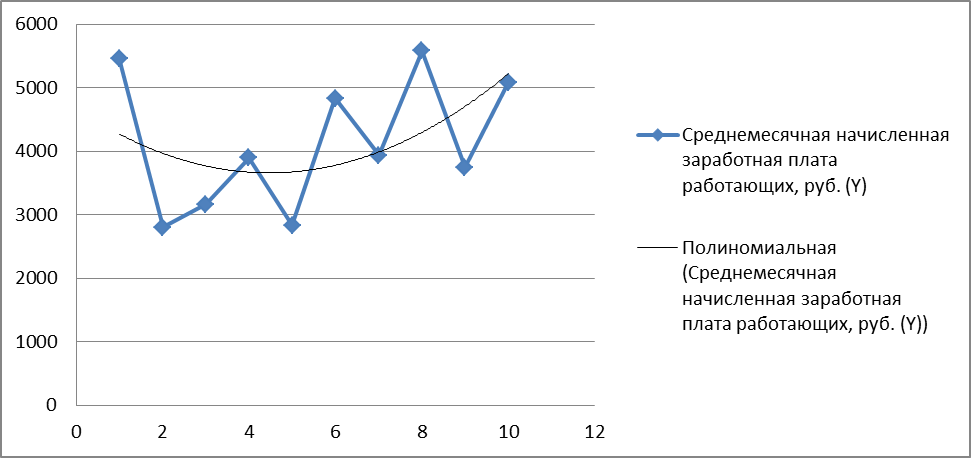

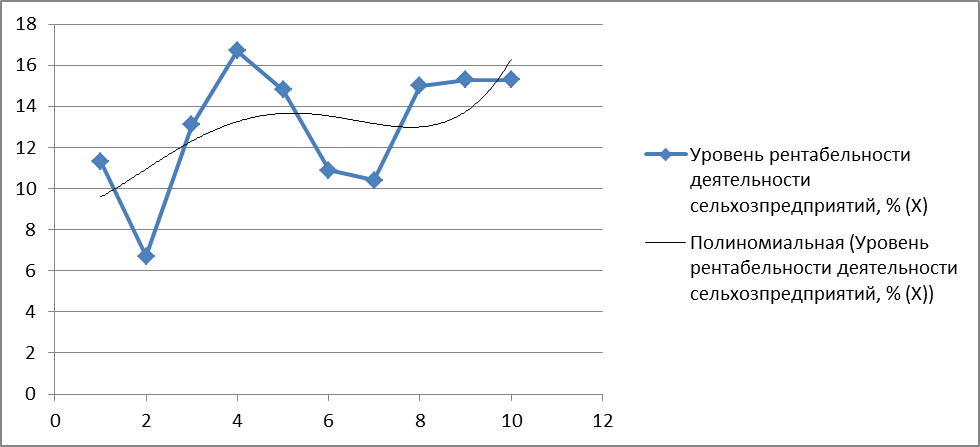

Решение: по данным табл.4.8 Построим диаграммы, показывающие зависимость каждого из показателей от времени (x-t,y-t) и друг от друга (x-y).  Рис.1. Динамика среднемесячной начисленной зарплаты работающих за период с 1 по 10 год, руб. На диаграмме прослеживается нелинейная (полиномиальная) зависимость между показателями.  Рис.2. Динамика рентабельности деятельности сельхозпредприятий за период с 1 по 10 год, % На диаграмме прослеживается нелинейная (полиномиальная) зависимость между показателями.  Рис.3. Зависимость между среднемесячной начисленной зарплатой работающих и уровнем рентабельности деятельности сельхозпредприятий. На диаграмме прослеживается нелинейная (полиномиальная) зависимость между показателями. Для расчета коэффициентов корреляции составим вспомогательную таблицу. Таблица 1

Коэффициент корреляции между временем и среднемесячной начисленной зарплатой работников определяется по формуле (в качестве факторного признака Х выступает номер года t): |