Методы математической обработки данных педагогического исследования. мат пдф (1). Монография Чебоксары 2019 удк 796799 ббк 75. 1 К72 Рецензенты др экон наук, профессор

Скачать 0.59 Mb. Скачать 0.59 Mb.

|

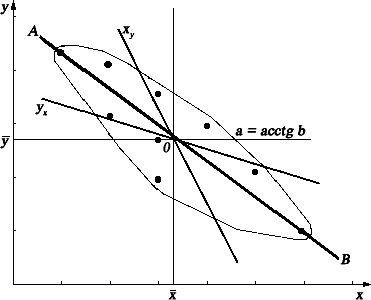

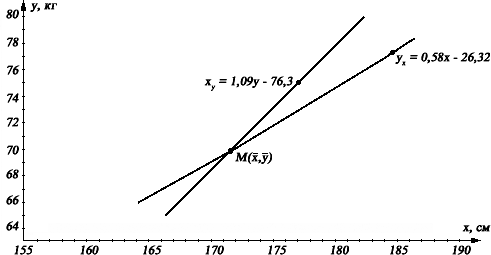

63; 75; 70; 70; 73; 75; 65; 70.Регрессионный анализПонятиерегрессии. В практических исследованиях возникает необходимость аппроксими-ровать (описать приблизительно) диаграмму рассеяния математиче-ским уравнением. То есть зависимость между переменными величинами Yи Хможно выразить аналитически с помощью формул и уравнений и графически в виде геометрического места точек в системе прямоугольных координат. График корреляционной зависимости строится по уравнениям функции ȳx = f(x) и x̄y = f(y), которые называются регрессией (термин “регрессия” происходит от лат. regressio– движение назад).Здесь ȳx и x̄y – средние арифметические из числовых значений зависимых перемен- ных Yи X. Для выражения регрессии служат эмпирические и теоретические ряды, их графики – линии регрессии, а также корреляционные уравнения(уравнениярегрессии)икоэффициентлинейнойрегрессии. Показатели регрессии выражают корреляционную связь двусторонне, учитывая изменение средней величины ȳx признака Y при изменении зна- чений xiпризнака X, и, наоборот, показывают изменение средней величины x̄y признака Хпо измененным значениям yiпризнака Y.Исключение состав- ляют временные ряды, или ряды динамики, показывающие изменение при- знаков во времени. Регрессия таких рядов является односторонней. Рядырегрессии, особенно их графики, даютнаглядноепредставлениео форме и тесноте корреляционной связи между признаками, в чем и за- ключается их ценность. Форма связи между показателями, влияющими на уровень спортивного результата и общей физической подготовки занима- ющихся физической культурой и спортом, может быть разнообразной. И поэтому задача состоит в том, чтобы любую форму корреляционной связи выразить уравнением определенной функции (линейной, параболической и т.д.), что позволяет получать нужную информацию о корреляции между переменными величинами Y и X, предвидеть возможные изменения при- знака Yна основе известных изменений X, связанного с Yкорреляционно. Уравнениелинейнойрегрессии. Обычно признак Yрассматривается как функция многих аргументов – x1,x2,x3,…,xm– и может быть записана в виде: y=a+bx1+cx2+dx3+…, где а,b,си d– параметры уравнения, определяющие соотношение между аргументами и функцией. В практике учитываются не все, а лишь некото- рые аргументы, в простейшем случае, как при описании линейной регрес- сии, – всего один: y =a+bx (2.4.1)  В этом уравнении параметр а – свободный член; графически он пред- ставляет отрезок ординаты (у) в системе прямоугольных координат. Па- раметр bназывается коэффициентомрегрессии. С точки зрения аналити- ческой геометрии b– угловой коэффициент, определяющий наклон линии регрессии по отношению к осям, координат. В области регрессионного анализа этот параметр показывает, насколько в среднем величина одного признака (Y) изменяется при изменении на единицу меры другого корре- ляционно связанного с Y признака X. Наглядное представление об этом параметре и о положении линий регрессии Y по Х и X по Y в системе пря- моугольных координат дает рисунок 2.4.1. В этом уравнении параметр а – свободный член; графически он пред- ставляет отрезок ординаты (у) в системе прямоугольных координат. Па- раметр bназывается коэффициентомрегрессии. С точки зрения аналити- ческой геометрии b– угловой коэффициент, определяющий наклон линии регрессии по отношению к осям, координат. В области регрессионного анализа этот параметр показывает, насколько в среднем величина одного признака (Y) изменяется при изменении на единицу меры другого корре- ляционно связанного с Y признака X. Наглядное представление об этом параметре и о положении линий регрессии Y по Х и X по Y в системе пря- моугольных координат дает рисунок 2.4.1.Рис. 2.4.1. Схема линий регрессии Yпо Хи Хпо Yв системе прямоугольных координат Линии регрессии, как показано, пересекаются в точке 0 (x̄, ȳ), соответ- ствующей средним арифметическим значениям корреляционно связанных друг с другом признаков Yи X. Линия АВ, проходящая через эту точку, изоб- ражает полную (функциональную) зависимость между переменными вели- чинами Yи X, когда коэффициент корреляции r= 1. Чем сильнее связь между Yи X, тем ближе линии регрессии к АВ, и, наоборот, чем слабее связь между варьирующими признаками, тем более удаленными оказываются линии ре- грессии от АВ. При отсутствии связи между признаками, когда r= 0, линии регрессии оказываются под прямым углом (90°) по отношению друг к другу. Уравнение регрессии тем лучше описывает зависимость, чем меньше рассеяние диаграммы, чем больше теснота взаимосвязи. Уравнение пря- мой линии пригодно для описания только линейных зависимостей. В слу- чае нелинейных зависимостей математическая запись может отобра- жаться уравнениями параболы, гиперболы и др. Необходимо также сделать одно важное замечание о значении показа- телей, характеризующих взаимосвязь признаков (коэффициентов корре- ляции, регрессии и т. п.). Все они дают лишь количественную меру связи, но ничего не говорят о причинах зависимости. Определить эти причины – дело самого исследователя. Коэффициентыуравненияпарнойлинейнойрегрессии. Как уже было определено выше, в случае линейной зависимости урав- нение регрессии является уравнением прямой линии. Таких уравнений два: Y = a1 + by/x ⋅ X¯ – прямое и X = a2 + bx/y ⋅ Y¯ – обратное, (2.4.2) где aи b– коэффициенты, или параметры, которые надлежит определить. Значение коэффициентов регрессии вычисляется по формуле: b = r ⋅ σy = ∑(xi—x̄)⋅(yi—ȳ) y/x σx и ∑(xi — x̄)2 bx/y = r ⋅ σx = ∑(xi–x̄)⋅(yi–ȳ ). (2.4.3) σy ∑(yi–ȳ )2 Коэффициенты регрессии b имеют размерность, равную отношению размерностей изучаемых показателей X и Y, и тот же знак, что и коэффи- циент корреляции. Коэффициенты аопределяются по формуле: a1 = Y¯ — by/x ⋅ X¯ и a2 = X¯ — bx/y ⋅ Y¯ . (2.4.4) Чтобы вычислить этот коэффициенты, надо просто в уравнения ре- грессии подставить средние значения коррелируемых переменных. Для оценки качества уравнений регрессии вычисляются остаточныесредниеквадратическиеотклонения(или абсолютныепогрешностиуравнений) по формуле: σy/x = σy ⋅ √1 — r2;  σx/y = σx ⋅ √1 — r2. (2.4.5) Эти оценки абсолютны и, следовательно, не могут быть сравнимы друг с другом. Поэтому вводят оценки относительнойпогрешностиурав-нений, которые выражаются в процентах и служат для точности пред-сказания (прогнозирования) результатов одного показателя по заранееизвестным значениям другого. Относительные погрешности уравнений регрессии определяются по формуле: σ/ = σy/x ⋅ 100%; y/x ȳ σ/ = σx/y ⋅ 100%. (2.4.6) x/y x̄ Значение этой оценки, если r = 1, равно нулю и, если r = 0, макси- мально. Остаточное среднее квадратическое отклонение характеризует колеблемость Y относительно линии регрессии по Х в прямом уравнении регрессии и, наоборот, в обратном случае. А, следовательно, чем меньше величина относительной погрешности уравнения регрессии, тем точнее будет оно осуществлять прогноз значений одного показателя по заранее известным значениям другого. Связьмеждукоэффициентамирегрессииикорреляции. Между коэффициентом корреляции и параметром парной линейной регрессии существует зависимость, которая применительно к выбороч- ным оценкам может быть представлена следующим образом: b = r ⋅ σY¯ , (2.4.7) σX¯ где σY¯ и σX¯ – средние квадратические ошибки. Приведенное выражение позволяет оценить параметр регрессии без решения системы нормальных уравнений при условии, что коэффициент корреляции уже определен. На основе формулы (2.4.7) легко показать, что выборочный коэффициент корреляции равен среднему геометрическому выборочных коэффициентов регрессии. Действительно, сравнив фор- мулы (2.4.3) с основной формулой (2.3.1) коэффициента корреляции, ви- дим, что их числители равны ∑(xi — x̄) ⋅ (yi — ȳ). Это свидетельствует об определенной связи между этими характеристиками. Выборочный коэф- фициент корреляции выражается тогда равенством r2=by/x bx/y, откуда r = ±√by/x ⋅ bx/y. (2.4.8) Эта формула ценна тем, что, во-первых, может быть использована для нахождения неизвестной величины коэффициента корреляции по извест- ным значениям коэффициента регрессии by/xи bx/y,а во-вторых, позволяет контролировать правильность расчета коэффициента корреляции, если известны величины by/xи bx/y. Знак выборочного коэффициента корреля- ции совпадает со знаком выборочных коэффициентов регрессии, что сле- дует из формулы (2.4.3). Если зависимость между признаками функцио- b нальная, то by/x = 1 x/y и, следовательно, r= 1. И, наоборот, при полном отсутствии взаимосвязи между признаками by/x= 0, bx/y= 0 и r= 0. Определениепараметровпарнойлинейнойрегрессии. Ряды регрессии – это ряды усредненных значений (yxи xy) варьирую- щих признаков Yи X,соответствующих значениям аргументов yiи xi.По- этому эмпирические уравнения регрессии следует записывать так: yx=ay/x+by/x xи xy=ax/y+bx/y y. (2.4.9) Формулы для определения параметров а и b принимают следующие выражения: ay/x = ȳ — by/x ⋅ x̄; ax/y = x̄ — bx/y ⋅ ȳ. (2.4.10) Уравнение линейной регрессии можно выразить в виде отклонений ва- риант от их средних арифметических: yx — ȳ = by/x ⋅ (xi — x̄); xy — x̄ = bx/y ⋅ (yi — ȳ). (2.4.11) В таком случае система нормальных уравнений для определения пара- метров аи bбудет следующая: an + b Σ(xi — x̄) = Σ(yi — ȳ); a Σ(xi — x̄) + b Σ(xi — x̄)2 = Σ(xi — x̄) ⋅ (yi — ȳ). Поскольку ∑(xi — x̄) = 0 и ∑(yi — ȳ) = 0, то параметр b выразится в виде приведенной формулы (2.2.3); параметр алегко найти по формуле (2.4.4). Если средние ȳ и x̄ перенести в правую часть уравнения (2.4.11), то при a = ȳ система нормальных уравнений принимает следующий вид: yx = ȳ + by/x ⋅ (xi — x̄); xy = x̄ + bx/y ⋅ (yi — ȳ). (2.4.12) Заменив в формуле (2.4.12) параметры by/xи bx/yна их значения из фор- мулы (2.4.3), получим систему уравнений парной линейной регрессии: y = ȳ + ∑(xi—x̄)⋅(yi—ȳ) ⋅ (x — x̄); x ∑(xi — x̄)2 y x = x̄ + ∑(xi–x̄)⋅(yi–ȳ) ⋅ (y — ȳ). (2.4.13) ∑(yi–ȳ )2 Эти уравнения удобны для определения параметров при отыскивании эмпирических уравнений регрессии в практической работе для точности прогнозирования результатов. Графическоепредставлениеуравненияпарнойлинейнойрегрессии. Эмпирические ряды регрессии Y по Х и Х по Y изображаются в виде линейного графика, при построении которого наиболее точным является использование способа наименьших квадратов, предложенного в 1806 г. К. Гауссом и независимо от него А. Лежандром. В основу этого способа положена теорема, согласно которой сумма квадратов отклонений вари- ант (xi) от среднего арифметического (x̄) есть величина наименьшая, т. е. ∑ (xi — x̄)2 = min. Отсюда и название метода, который нашел широкое применение не только в биологии, но и в технике. Мы уже говорили об этом методе и применяли его, когда находили параметры а и b линейной регрессии, отыскивая эмпирическое уравнение. При графическом изображении эмпирического уравнения регрессии (например, показатели роста и веса 10 исследуемых спортсменов), пред- ставленного на рисунке 2.4.2 используется следующая последовательность: Определив форму и направление взаимосвязи между эмпириче- скими данными на основе данных расчета нормированного коэффициента корреляции, производят расчет уравнений регрессии (прямого и обрат- ного) по формуле (2.4.13). Подставляя в конечный вид уравнений, выражающих зависимость между переменными величинами Yи X,эмпирические данные xiи yiнахо- дят координаты точек линий регрессии для усредненных значений yxи xy. На графике, выполненном в прямоугольной системе координат, на оси хоткладывают значения переменных xi, на оси у– значения yiи отме- чают точками рассчитанные координаты линий регрессии для усреднен- ных значений yxи xy(рис. 2.4.2).  Две линии регрессии на графике пересекаются в точке М с коорди- натами средних значений показателей xiи yi. Две линии регрессии на графике пересекаются в точке М с коорди- натами средних значений показателей xiи yi.Рис. 2.4.2. Графическое изображение эмпирического уравнения регрессии График линий регрессии отражает ряды теоретически ожидаемых зна- чений функции по известным значениям аргумента. При этом, чем силь- нее взаимосвязь между величинами xiи yi, тем меньше угол между лини- ями регрессии. При r = 1 линии уравнения регрессии либо совпадают, либо расположены параллельно, так как корреляционная зависимость между признаками в этом случае переходит в функциональную. И, наобо- рот, чем слабее зависимость между признаками, тем больше угол между линиями на графике. При r = 0 линии регрессии расположены перпенди- кулярно. Пример 2.4.1. Рассчитать и построить график уравнения прямолинейной ре- грессии для показателей роста и веса 8 исследуемых и сделать вывод о точности расчета уравнений, если данные выборок таковы: xi, см |